Vous utilisez l’IA pour produire du contenu, analyser ou automatiser… mais les résultats restent inconstants, parfois approximatifs, rarement au niveau attendu ?

Le véritable levier ne réside pas dans l’outil, mais dans votre maîtrise du prompt engineering. Sans méthode, vous obtenez des réponses génériques, peu exploitables, qui nécessitent des corrections permanentes. Cette inefficacité ralentit vos équipes et limite fortement le potentiel de l’IA dans votre organisation. À l’inverse, un prompt structuré et précis permet d’obtenir des réponses fiables, directement actionnables. Dans cet article, vous allez comprendre comment améliorer radicalement vos résultats grâce à une approche rigoureuse du prompt engineering.

Si vous utilisez l’IA pour gagner du temps sur vos tâches perso, très bien. Mais si votre objectif est de construire des systèmes fiables, vendre des solutions B2B, automatiser des workflows, créer des agents IA, des voice agents ou des outils exploitables en production, alors votre niveau réel en prompt engineering est probablement le facteur qui vous freine le plus.

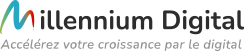

Le problème, c’est que beaucoup de personnes restent bloquées dans une zone intermédiaire. Elles collectionnent des templates, copient des “prompts ultimes”, empilent des hacks, puis se retrouvent totalement perdues dès qu’un modèle ne répond pas comme prévu. À ce moment-là, elles compensent en passant à un modèle plus cher, plus lent, et souvent inutilement puissant.

À l’inverse, les gens vraiment solides en prompt engineering comprennent les mécanismes derrière les prompts. Ils ont une boîte à outils. Ils savent pourquoi une technique marche, quand l’utiliser, et comment corriger un comportement indésirable sans tout jeter.

C’est exactement cette bascule que je veux vous faire faire ici.

Parce qu’un prompt bien écrit peut remplacer des centaines de lignes de code, réduire vos coûts, accélérer vos systèmes et surtout rendre vos solutions IA suffisamment fiables pour créer une vraie valeur business.

Gagnez du temps en lisant notre sommaire :

Step 1: Comprendre pourquoi la majorité se trompe sur le prompt engineering

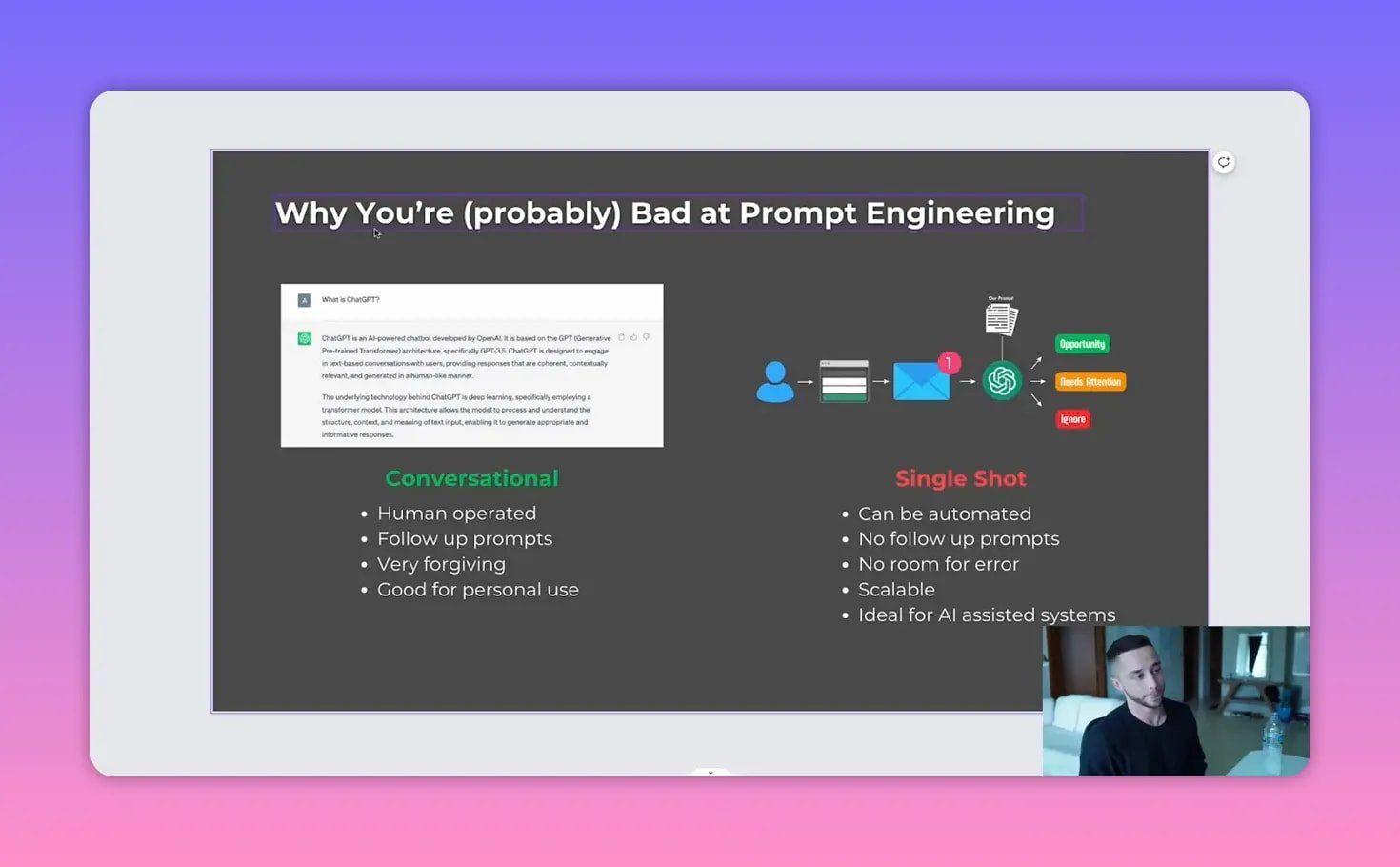

Il y a deux manières très différentes d’utiliser un modèle de langage.

Le mode conversationnel

C’est ce que tout le monde appelle, à tort, du prompt engineering. Vous ouvrez ChatGPT, vous tapez une consigne, vous obtenez une réponse, puis vous corrigez avec quelques messages derrière.

Par exemple :

- “Refais ça un peu plus court”

- “Ajoute un ton plus professionnel”

- “Non, ce n’est pas ce que je voulais”

- “Réécris en gardant la structure”

Ce mode est indulgent, parce qu’il y a un humain dans la boucle. Vous pouvez rattraper les erreurs. Vous pouvez préciser. Vous pouvez recadrer.

C’est utile. Je l’utilise moi aussi. Mais ce n’est pas suffisant si vous voulez construire un système.

Le mode single-shot

Là, on parle de la vraie discipline utile en B2B. Vous avez un prompt intégré dans un workflow, dans un agent, dans une automation, dans un outil. Il n’y a pas de relance humaine. Le modèle doit faire le job correctement du premier coup.

Exemples :

- classifier un email entrant

- extraire des données d’un formulaire

- résumer un appel commercial

- ranger une demande dans le bon pipeline

- piloter une étape d’un voice agent

Dans ce contexte, si le modèle répond “Bien sûr, voici le résultat :”, votre système peut casser.

Le prompt engineering utile, celui qui fait gagner de l’argent, c’est donc la capacité à obtenir une sortie fiable, exploitable, répétable, et suffisamment peu coûteuse pour tenir économiquement.

Voilà la vraie séparation :

- Le prompting conversationnel vous aide à mieux travailler

- Le prompting single-shot vous permet de construire des systèmes vendables

Et si vous travaillez dans l’IA appliquée au B2B, c’est le deuxième qui compte.

Step 2: Prendre le prompt engineering au sérieux comme compétence business

Il faut arrêter de voir le prompt engineering comme un petit bonus sympa. C’est une compétence centrale.

Andrej Karpathy a résumé ça avec une phrase devenue célèbre :

The hottest new programming language is English.

L’idée n’est pas juste “on parle à l’IA en anglais”. L’idée, c’est que des instructions bien écrites peuvent désormais remplacer une partie du code qu’il aurait fallu écrire autrement.

Autrement dit :

- vous pouvez traduire une intention métier en logique exécutable

- vous pouvez remplacer une portion de programmation par une consigne bien structurée

- vous pouvez obtenir les capacités d’un développeur sur certains blocs fonctionnels, si vous savez écrire proprement pour un LLM

Un exemple concret : un système de gestion de dépenses à partir de captures d’écran bancaires. En pratique, il s’agit de prendre une image, extraire la transaction, la catégoriser, puis l’envoyer dans Notion. Plutôt que de coder toute cette logique de manière lourde, un prompt bien conçu a permis de faire le travail en deux heures de conception, puis d’économiser environ huit heures par mois ensuite.

Ce n’est pas juste “pratique”. C’est du levier.

Et surtout, si vous êtes dans un contexte B2B, tout repose là-dessus :

- les agents IA

- les voice agents

- les automatisations avec Make ou Zapier

- les outils personnalisés construits sur des plateformes no-code ou low-code

Si votre prompt engineering est faible, tout le reste est instable.

Step 3: Ne plus dépendre de templates magiques

Le template n’est pas le problème. En dépendre, si.

Beaucoup de gens utilisent des “prompts ultimes” sans comprendre ce qu’ils font. Tant que ça marche, ils se sentent compétents. Dès que ça rate, ils sont bloqués. Ils ne savent pas quel composant corriger, quel ordre changer, quel niveau de détail ajouter, ni même si le problème vient du rôle, des exemples, du contexte ou du format de sortie.

Le mauvais réflexe derrière, c’est toujours le même : monter en gamme sur le modèle.

- passer de GPT-3.5 à GPT-4

- accepter un temps de réponse plus long

- payer beaucoup plus cher

- dégrader l’économie du système

Le bon réflexe, c’est l’approche ingénieur :

- comprendre les composants d’un prompt

- comprendre les effets connus de certaines techniques

- corriger le problème à la source

- tirer le maximum du modèle le moins cher possible

En B2B, cette différence est énorme. Un système plus rapide et moins coûteux crée plus de marge, plus de valeur perçue, et plus de chances d’être adopté durablement.

Step 4: Utiliser la structure de prompt engineering qui marche vraiment

Je vais volontairement parler de “formule”, mais avec précaution. Le but n’est pas que vous deveniez dépendant d’une recette rigide. Le but est que vous compreniez les briques utiles du prompt engineering.

La structure que j’utilise repose sur six composants :

- Role

- Task

- Specifics

- Context

- Examples

- Notes

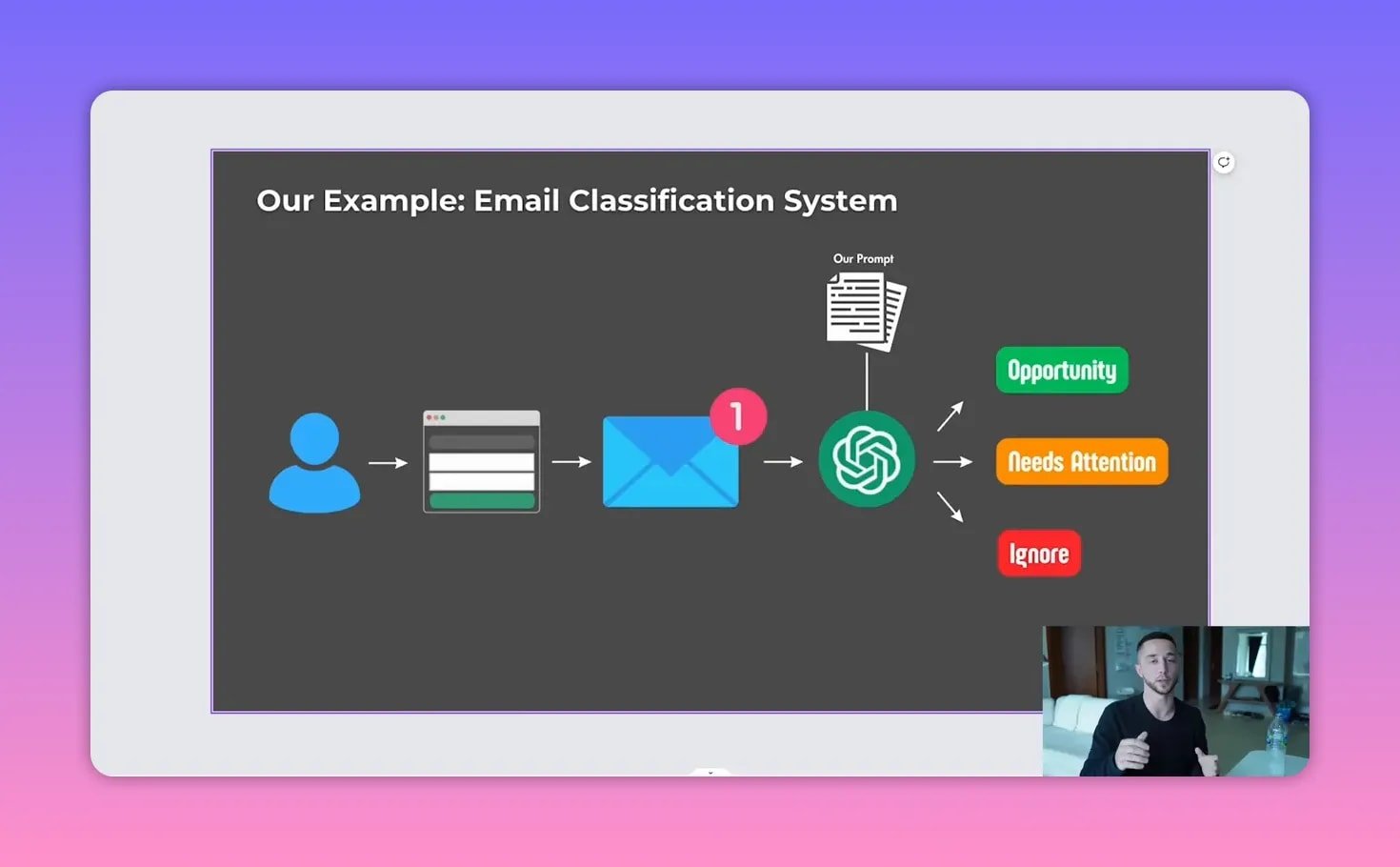

Pour illustrer tout ça, prenons un cas simple mais réaliste : un système qui classe des emails entrants dans trois catégories :

- Opportunity

- Needs Attention

- Ignore

La version naïve du prompt ressemble à ça :

Classify the following email into Ignore, Opportunity, or Needs Attention.C’est mieux que rien. Mais pour un vrai système, c’est très faible.

Step 5: Ajouter un rôle fort pour améliorer la précision

Le premier levier de prompt engineering, c’est le role prompting.

Au lieu de donner uniquement une instruction brute, vous assignez au modèle un rôle avantageux pour la tâche.

Exemple :

You are an experienced email classification assistant that accurately categorizes emails based on their content and potential business impact.L’idée est simple : vous ne dites pas seulement ce qu’il doit faire, vous lui indiquez aussi qui il est dans le cadre de cette tâche.

Mieux encore, vous enrichissez ce rôle avec des qualités utiles :

- précis

- créatif si nécessaire

- fiable

- capable d’analyser l’impact business

Sur certaines tâches, cette simple technique peut déjà améliorer sensiblement la performance.

Ce qu’il faut retenir :

- choisissez un rôle aligné avec la tâche

- ajoutez des attributs qui renforcent ce rôle

- évitez les rôles vagues du type “tu es une IA utile”

En prompt engineering, la qualité du cadrage initial compte énormément.

Step 6: Définir la tâche comme une procédure, pas comme une vague demande

Le composant Task est souvent le seul que les gens écrivent. Et ils l’écrivent mal.

Une bonne tâche commence par un verbe clair et décrit précisément ce que le modèle doit faire.

Mais surtout, pour les systèmes automatisés, il faut intégrer une logique de traitement. C’est là qu’intervient le chain of thought prompting, ou à minima une version structurée de raisonnement étape par étape.

Concrètement, au lieu de dire juste “classe cet email”, vous pouvez dire au modèle de :

- lire l’email

- identifier l’intention principale

- évaluer l’impact business potentiel

- choisir l’une des trois étiquettes autorisées

- renvoyer uniquement cette étiquette

Le bénéfice est massif sur les tâches multi-étapes.

Et c’est encore plus important si vous injectez des variables dynamiques dans le prompt. Dans un workflow, le contenu de l’email sera une variable. Le prompt doit donc être conçu pour recevoir cet input proprement et l’interpréter de manière stable.

À retenir :

- la tâche doit être explicite

- les étapes de raisonnement doivent être guidées

- les variables dynamiques doivent être prévues dès la rédaction

Step 7: Ajouter des specifics pour verrouiller l’exécution

Le bloc Specifics sert à ajouter des contraintes ou précisions importantes sans alourdir le bloc principal de la tâche.

C’est souvent ici que je fais la majorité de mes ajustements quand j’itère un prompt.

Par exemple :

- si l’email mentionne une demande commerciale claire, classez-le comme Opportunity

- si le message implique un problème urgent ou une demande de support, utilisez Needs Attention

- si le contenu est sans valeur business évidente, utilisez Ignore

Vous pouvez aussi y ajouter un levier sous-estimé : l’emotion prompting.

Oui, ça a l’air ridicule. Oui, ça fonctionne souvent très bien.

Exemples de formulations :

- Cette tâche est essentielle pour le succès de notre entreprise

- Votre analyse rigoureuse est très importante pour notre activité

- Cette classification a un impact direct sur la qualité de notre suivi commercial

Pourquoi ça aide ? Parce que cela pousse le modèle à traiter la tâche avec davantage de soin, surtout sur des tâches complexes.

Ce n’est pas de la magie. C’est un biais exploitable. Et en prompt engineering, si trois mots en plus améliorent la sortie, vous les utilisez.

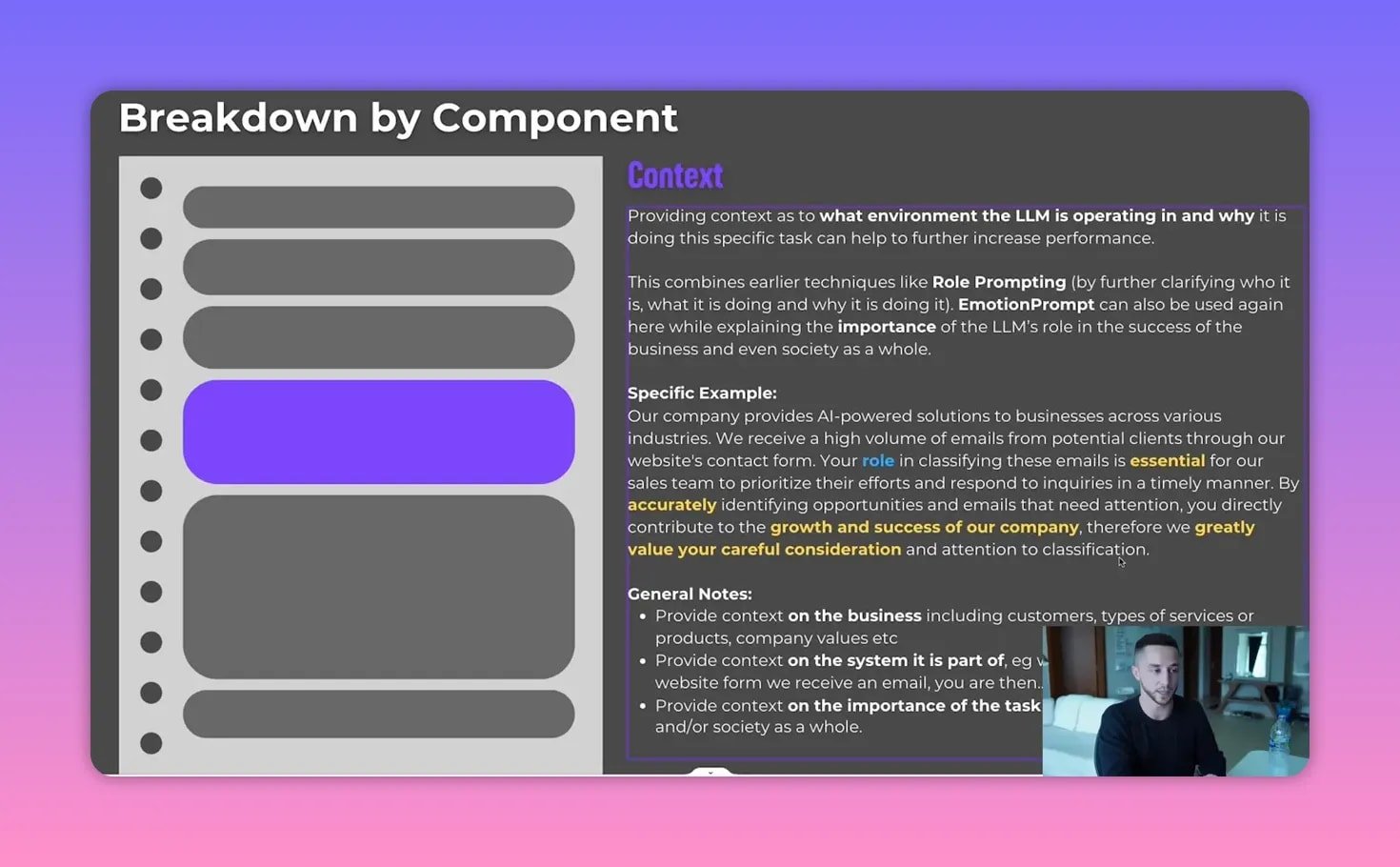

Step 8: Donner le bon contexte métier

Le bloc Context répond à une question simple : dans quel environnement ce modèle opère-t-il, et pourquoi cette tâche existe-t-elle ?

Un modèle travaille mieux quand il comprend l’entreprise, le système et l’objectif métier autour de lui.

Pour notre classificateur d’emails, un bon contexte pourrait préciser :

- le type d’entreprise

- la nature des clients servis

- le rôle du formulaire de contact dans le funnel commercial

- l’importance de prioriser correctement les demandes

Exemple d’idée :

Votre entreprise fournit des solutions IA à des clients B2B dans plusieurs secteurs. Vous recevez un grand volume d’emails issus du formulaire de contact du site. Votre rôle est de classer chaque message afin d’aider l’équipe commerciale à prioriser les demandes à forte valeur.

Ce bloc permet aussi de réinjecter intelligemment :

- du role prompting

- de l’emotion prompting

- de la logique business

Le contexte ne doit pas être romanesque. Il doit être utile.

Step 9: Utiliser quelques exemples bien choisis

Le bloc Examples est l’un des leviers les plus puissants du prompt engineering.

On parle ici de few-shot prompting : vous donnez au modèle quelques paires entrée-sortie pour lui montrer exactement ce que vous attendez.

Exemple :

Email: "Hi, we're looking for an AI agency to help automate lead qualification for our sales team."

Label: Opportunity

Email: "Your booking page is broken and our team cannot access the dashboard."

Label: Needs Attention

Email: "Just checking if you received my newsletter subscription."

Label: IgnorePourquoi c’est si fort ?

Parce que les exemples n’apprennent pas seulement au modèle le “bon résultat”. Ils lui apprennent aussi :

Boostez vos ventes avec notre agence Marketing IA

La seule Agence payée aux Résultats

- le format attendu

- la longueur attendue

- le style de réponse attendu

- la structure de sortie à respecter

Et c’est un point essentiel : dans beaucoup de cas, les few-shot examples servent davantage à calibrer la forme qu’à enseigner une information nouvelle.

En pratique :

- un seul bon exemple peut déjà faire une énorme différence

- trois à cinq exemples suffisent souvent

- au-delà, les gains diminuent alors que les coûts augmentent

Dans des systèmes à volume élevé, chaque exemple ajoute des tokens d’entrée. Donc oui, le few-shot prompting améliore la qualité, mais il faut garder un œil sur la rentabilité.

Un conseil très utile remonté en pratique : ne choisissez pas seulement les cas les plus fréquents. Choisissez aussi les cas que le modèle rate le plus souvent. Les exemples difficiles améliorent souvent plus les résultats que les exemples évidents.

Step 10: Finir avec des notes courtes mais stratégiques

Le bloc Notes sert à ajouter les derniers rappels importants.

C’est souvent là que j’ajoute les petites corrections après les premiers tests :

- répondez uniquement avec l’étiquette

- n’incluez aucun texte supplémentaire

- si vous hésitez, classez en Needs Attention

- n’incluez aucune donnée personnelle dans la réponse

Pourquoi ce bloc à la fin ? À cause d’un effet connu appelé lost in the middle.

Les modèles ont tendance à mieux retenir ce qui se trouve :

- au début du prompt

- à la fin du prompt

Et à moins bien exploiter ce qui se trouve au milieu, surtout quand le contexte devient long.

Conséquence directe pour votre prompt engineering :

- mettez les éléments les plus critiques au début et à la fin

- évitez de noyer le modèle dans trop de texte

- gardez les notes courtes et ciblées

Le bloc Notes n’est pas un dépotoir. C’est une zone de rappel stratégique.

Step 11: Structurer vos prompts en Markdown

C’est probablement l’astuce la plus simple à adopter immédiatement.

Au lieu d’écrire votre prompt comme un gros pavé de texte, structurez-le en Markdown.

Exemple :

# Role

You are an experienced email classification assistant...

# Task

Classify the incoming email into one of the following labels...

# Specifics

- If the email contains...

- If the message indicates...

# Context

## About the business

...

## About the system

...

# Examples

## Example 1

Email: ...

Label: Opportunity

## Example 2

Email: ...

Label: Ignore

# Notes

- Return only the label

- Do not include explanationsLes avantages sont doubles :

- pour vous : le prompt devient lisible, modifiable, maintenable

- pour le modèle : la structure est plus explicite

Il existe peu de certitudes absolues sur le gain exact, mais il y a un signal pratique fort : même OpenAI utilise ce type de structuration dans certains prompts système. Et d’un point de vue intuitif, cela colle bien avec la manière dont les modèles ont été entraînés sur des données structurées.

En B2B, la maintenabilité compte autant que la performance brute. Un prompt markdowné est plus facile à auditer, transmettre à une équipe, versionner et optimiser.

Step 12: Assembler le prompt engineering complet

Une fois tous les blocs réunis, vous obtenez un prompt beaucoup plus robuste que la version de départ.

Vous avez :

- un rôle clair

- une tâche procédurale

- des précisions critiques

- du contexte métier

- des exemples de sortie

- des notes finales bien placées

- une structure en Markdown

Pris séparément, chacun de ces éléments peut sembler banal. Ensemble, ils changent radicalement le niveau de fiabilité du système.

C’est ça, le vrai prompt engineering. Pas une phrase magique. Une architecture d’instructions.

Step 13: Optimiser pour le coût, la vitesse et la production

Un bon système IA ne doit pas seulement fonctionner. Il doit fonctionner au bon coût.

Si votre tâche tourne à fort volume, gardez en tête deux choses :

1. Les tokens d’entrée coûtent aussi de l’argent

À chaque exécution, vous payez :

- le prompt lui-même

- les variables injectées

- la sortie générée

Donc si vous avez un prompt énorme avec 20 exemples, chaque appel coûte plus cher. Sur 100, 1 000 ou 10 000 appels, cela se voit immédiatement.

2. Le meilleur prompt engineering vous permet d’utiliser des modèles moins chers

L’objectif n’est pas de partir directement sur le modèle le plus intelligent. L’objectif est d’obtenir le niveau de qualité nécessaire avec le modèle le plus rapide et le moins cher possible.

En clair :

- commencez simple

- testez sur un modèle économique

- améliorez le prompt

- ne montez de gamme que si c’est réellement nécessaire

C’est là que la compétence fait la différence entre une démo sympa et un système rentable.

3. Réglez la température correctement

Pour la plupart des systèmes métiers, je mets la température à 0.

Pourquoi ? Parce que vous voulez de la cohérence, pas de la créativité.

Utilisez une température plus élevée uniquement pour :

- la rédaction créative

- l’idéation

- les scripts marketing

Pour la classification, l’extraction, le routage, l’analyse structurée, gardez-la à zéro.

Step 14: Comprendre comment tirer plus d’un modèle moins puissant

Un cas très parlant : un système construit d’abord sur GPT-4 fonctionne parfaitement, puis le client demande de passer sur GPT-3.5 pour réduire les coûts. Là, tout devient intéressant.

Quand vous descendez en gamme de modèle, deux stratégies deviennent cruciales :

- améliorer le prompt engineering

- réduire le scope de chaque tâche

GPT-4 gère mieux la complexité implicite. GPT-3.5 a besoin d’une tâche plus découpée, plus explicite, plus guidée. Il faut donc souvent :

- scinder un gros traitement en sous-tâches

- réécrire les prompts pour réduire l’ambiguïté

- renforcer les exemples

- limiter ce qu’on demande à chaque appel

Autrement dit, un modèle moins puissant exige un meilleur design système.

Il existe aussi une stratégie hybride intéressante : utiliser GPT-4 pour générer de bonnes paires entrée-sortie, puis s’en servir comme base de few-shot prompting, voire de fine-tuning léger si le cas d’usage le justifie. Mais dans l’immense majorité des situations, un excellent prompt engineering vous emmènera déjà très loin sans fine-tuning.

Step 15: Appliquer ces principes aux agents IA, aux voice agents, aux automations et aux outils

Cette structure n’est pas réservée à un classificateur d’emails. Elle se réutilise partout.

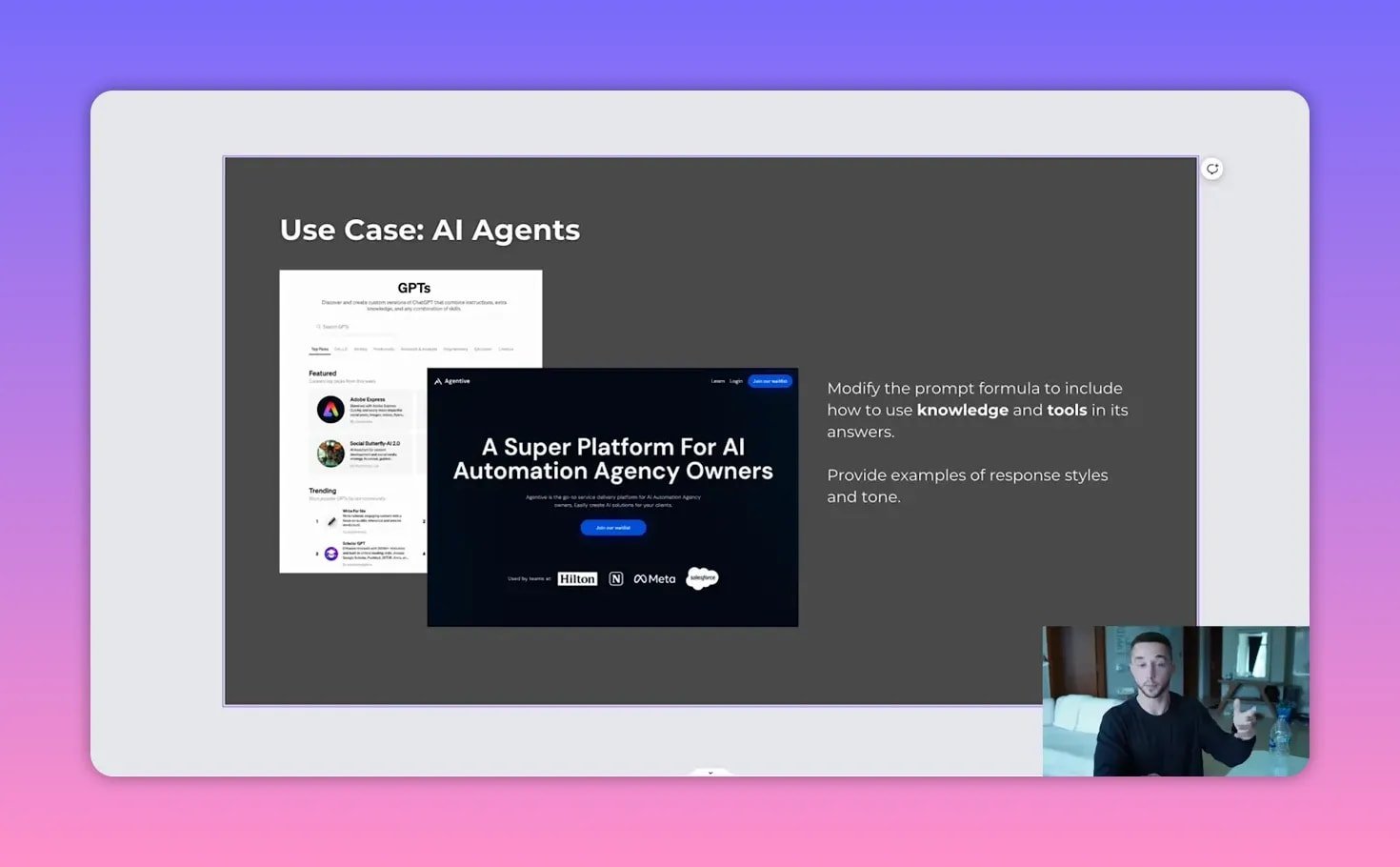

Agents IA

Pour un agent IA, gardez la même base, mais ajoutez des sections spécifiques comme :

- comment utiliser la base de connaissances

- quand appeler un outil

- comment choisir entre plusieurs outils

- quel ton adopter dans les réponses

Si votre agent a accès à une knowledge base ou à un outil de recherche sémantique, dites-le explicitement. Décrivez à quoi sert chaque outil et dans quel cas l’utiliser.

Voice agents

Pour un voice agent, vous pouvez conserver les six blocs, mais ajouter :

- une trame de conversation

- les étapes du script

- les réponses attendues aux objections fréquentes

- le ton oral à adopter

Le prompt engineering d’un voice agent doit être plus conversationnel dans la forme, mais tout aussi structuré dans le fond.

Automations IA

Dans Make, Zapier ou d’autres outils, le bloc AI devient une étape au milieu d’un workflow. Là, le single-shot prompting est indispensable.

Le format de sortie doit être extrêmement propre, parce qu’il sera réutilisé par les étapes suivantes. C’est le bon terrain pour :

- les few-shot examples

- les notes de format

- les rappels “retourne uniquement X”

Outils IA personnalisés

Si vous créez un outil avec des champs variables comme :

- niche

- offre

- segment client

- objectif

alors votre prompt devient un template structuré dans lequel vous injectez des variables. La logique reste la même. Le niveau de qualité dépend directement de votre prompt engineering.

Step 16: Adopter quelques tactiques avancées qui améliorent vraiment les résultats

Voici quelques tactiques supplémentaires utiles en pratique.

Utilisez des formulations encourageantes

Oui, vraiment.

Des phrases du style :

- vous êtes un expert de classe mondiale en X

- vous excellez dans cette tâche

- réfléchissez soigneusement avant de répondre

peuvent améliorer la qualité des sorties.

Dites au modèle de réfléchir étape par étape

La formule “take a deep breath and think step by step” est presque devenue un mème, mais elle est utile. Même si vous n’utilisez pas exactement cette phrase, l’idée de pousser à un raisonnement décomposé reste excellente.

Utilisez parfois une persona précise

Attribuer un nom ou une identité connue peut parfois aider sur des styles ou des approches très spécifiques. Par exemple, demander une refactorisation “comme le ferait tel développeur connu” peut orienter le style de réponse.

Ce n’est pas indispensable, mais c’est une piste intéressante pour certaines tâches spécialisées.

Préférez souvent les formulations positives

Au lieu de multiplier les “ne fais pas ceci”, essayez quand c’est possible de formuler ce qu’il faut faire. Les consignes positives produisent parfois de meilleurs résultats que les consignes négatives. Cela dit, en pratique, un “do not include any extra text” bien placé peut aussi être très utile. Testez, comparez, gardez ce qui marche.

Step 17: Passer d’un utilisateur de prompts à un ingénieur des instructions

Le vrai objectif n’est pas d’apprendre une formule par cœur.

Le vrai objectif est de développer un diagnostic mental :

- si la structure de sortie est mauvaise, ajoutez ou améliorez les exemples

- si le modèle oublie une consigne importante, replacez-la au début ou à la fin

- si la tâche est floue, découpez-la en étapes

- si les résultats sont trop faibles, réduisez le scope ou enrichissez le rôle

- si les coûts explosent, raccourcissez le prompt et testez un modèle moins cher

À partir de là, vous n’êtes plus dépendant d’un template trouvé sur internet. Vous avez une méthode.

Step 18: Retenir l’idée la plus importante

Si vous construisez des solutions IA pour des entreprises, le prompt engineering n’est pas une compétence annexe. C’est le cœur du réacteur.

Votre capacité à écrire de bonnes instructions détermine :

- la qualité des résultats

- la vitesse de réponse

- le coût d’exploitation

- la fiabilité du système

- la valeur créée pour le client

Et à terme, c’est ce qui fait la différence entre :

- un bricolage cher qui impressionne en démo

- un vrai système utile, rentable et vendable

Le plus intéressant, c’est que les gains viennent souvent de choses simples :

- un rôle mieux écrit

- quelques étapes explicites

- trois bons exemples

- une note finale bien placée

- une structure propre en Markdown

Rien de tout ça n’est sexy. Mais c’est exactement pour ça que ça donne un avantage durable.

FAQ sur le prompt engineering

Le prompt engineering consiste-t-il seulement à écrire de meilleurs prompts dans ChatGPT ?

Non. Discuter avec ChatGPT améliore votre usage personnel de l’IA, mais le vrai prompt engineering consiste à concevoir des instructions fiables pour des systèmes automatisés. Dans un contexte B2B, le modèle doit souvent réussir du premier coup, sans intervention humaine.

Combien d’exemples faut-il mettre dans un prompt ?

En pratique, trois à cinq exemples bien choisis suffisent souvent. Un seul bon exemple peut déjà produire un saut de qualité important. Au-delà, les gains deviennent plus faibles alors que le coût en tokens augmente.

Faut-il toujours utiliser GPT-4 pour obtenir de bons résultats ?

Non. Un bon prompt engineering permet souvent d’obtenir des résultats très corrects avec des modèles moins chers et plus rapides. L’objectif doit être d’utiliser le modèle le plus économique possible tout en atteignant la qualité nécessaire.

Le fine-tuning est-il indispensable ?

Dans la majorité des cas, non. Un excellent prompt engineering, combiné à du few-shot prompting, permet déjà d’aller très loin. Le fine-tuning n’est utile que dans certains cas particuliers où le volume, la spécialisation ou les contraintes métier le justifient réellement.

Pourquoi structurer un prompt en Markdown ?

Parce que cela rend le prompt plus lisible, plus maintenable et souvent plus clair pour le modèle. Les sections explicites comme Role, Task, Context, Examples et Notes facilitent l’itération et réduisent le désordre dans des prompts complexes.

Quelle température utiliser pour les systèmes B2B ?

Pour la plupart des cas métier, utilisez une température à 0. Cela réduit la variabilité et améliore la cohérence. Réservez les températures plus élevées aux usages créatifs comme l’idéation ou la rédaction marketing.

Quelle est la meilleure façon d’améliorer un prompt qui ne fonctionne pas ?

Ne recommencez pas tout de zéro. Identifiez le problème précis. Si la structure de sortie est mauvaise, ajoutez des exemples. Si une consigne est ignorée, déplacez-la au début ou à la fin. Si la tâche est trop floue, découpez-la en étapes. Si le coût est trop élevé, raccourcissez le prompt.