Lorsqu’un nouveau modèle promet des performances proches du très haut de gamme tout en divisant les coûts par quatre, voire par sept selon les cas, la vraie question n’est pas seulement technique.

Elle est business.

Deepseek V4 mérite donc d’être analysé avec une logique de ROI, de qualité de sortie, de vitesse d’exécution et de risque opérationnel. Si vous cherchez à arbitrer entre performance et budget pour du prototypage, des agents, du code, des interfaces web ou des usages créatifs, ce modèle devient immédiatement intéressant.

Gagnez du temps en lisant notre sommaire :

Automatisez ce qui vous fait perdre du temps !

demandez vos conseils gratuits à notre agence

J’ai donc pris Deepseek V4 au sérieux, pas comme une simple nouveauté IA de plus, mais comme un candidat crédible face aux références actuelles.

L’objectif n’était pas de répéter une fiche produit, mais de le pousser dans des cas concrets avec une batterie de prompts suffisamment exigeants pour révéler ses forces et ses limites.

Le verdict est nuancé, ce qui est généralement le signe d’un test utile.

Il y a de très bonnes surprises,

quelques déceptions franches,

et surtout un enseignement très clair : Deepseek V4 peut avoir une place très forte dans une stack IA orientée performance-coût, à condition de savoir sur quels usages le positionner.

Étape 1 : comprendre ce que Deepseek V4 change vraiment

Deepseek V4 arrive avec deux déclinaisons bien distinctes :

- Flash, pensée pour la vitesse et la maîtrise des coûts

- Pro, orientée agents et tâches complexes

Ce simple découpage donne déjà un signal important. Nous ne sommes pas face à un modèle unique censé tout faire parfaitement. Nous sommes face à une offre segmentée, ce qui permet de mieux aligner le coût d’inférence avec la complexité réelle des usages.

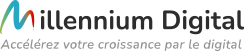

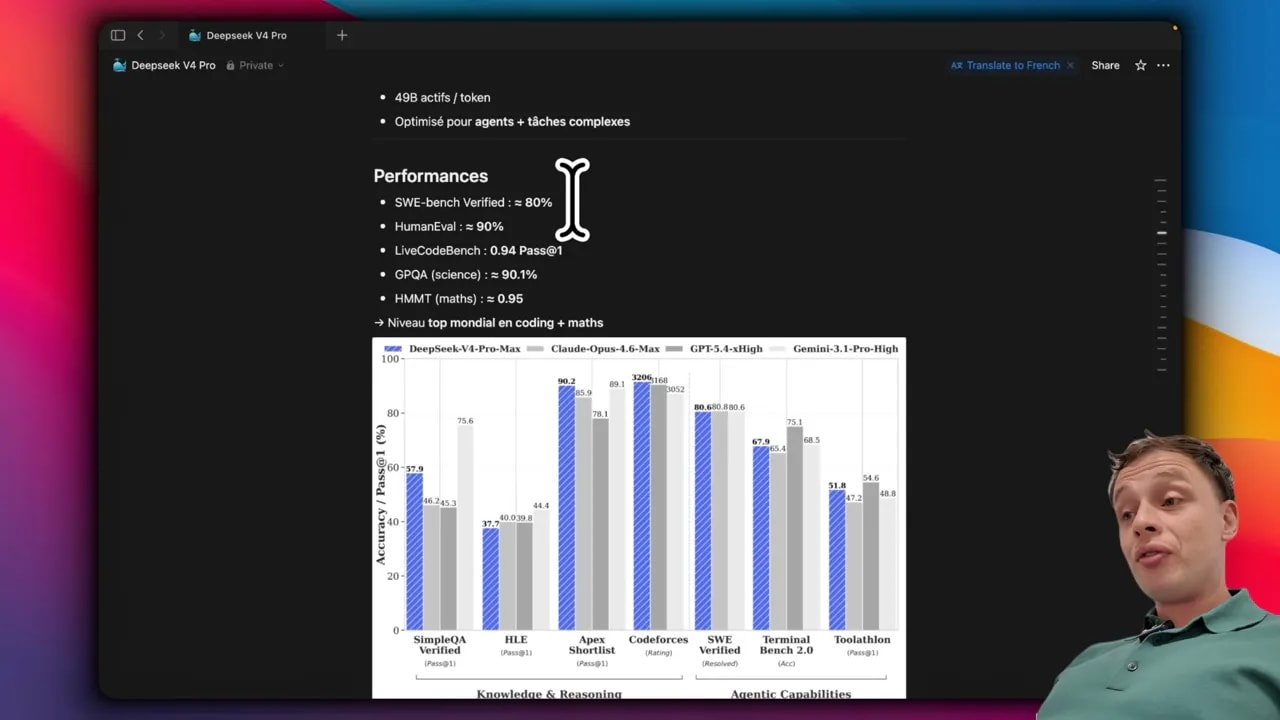

Sur les benchmarks communiqués, le point le plus marquant est le score sur SWE Bench Verified, autour de 80,6 %. C’est un excellent niveau, très proche de Claude Opus 4.6 Max annoncé à 80,8 %. Autrement dit, sur le papier, Deepseek V4 ne joue pas dans la petite ligue.

Évidemment, un benchmark n’est jamais suffisant pour décider d’un déploiement.

Il faut ensuite aller sur le terrain réel : qualité de génération, cohérence, respect des contraintes, robustesse dans les interactions longues, et comportement sur des tâches imparfaitement spécifiées. C’est précisément là que les tests concrets deviennent utiles.

Pourquoi cette sortie est stratégique

Il y a trois raisons pour lesquelles Deepseek V4 mérite une attention particulière :

- Le niveau de performance affiché, qui le place à proximité des meilleurs modèles fermés

- Le pricing, très agressif

- L’optimisation matérielle, incluant les alternatives à Nvidia

Pour une organisation qui raisonne en marge, en volume de requêtes ou en industrialisation d’agents IA, cette combinaison change la discussion. Le sujet n’est plus seulement “est-ce que le modèle est bon ?”, mais “à quel coût marginal pouvons-nous l’utiliser à grande échelle ?”.

Étape 2 : évaluer l’architecture sans tomber dans le fétichisme technique

Deepseek V4 repose toujours sur une architecture de type Mixture of Experts, souvent abrégée en MoE. Pour simplifier, cela signifie que le modèle n’active pas nécessairement toute sa capacité à chaque requête. Il mobilise certains “experts” internes selon la tâche. L’intérêt est connu : améliorer le rapport entre puissance théorique et coût effectif d’exécution.

Deux autres éléments sont mentionnés comme structurants :

- N-gram memory, utilisé pour la mémoire

- MHC, utilisé pour la stabilité

Dans une logique métier, il faut traduire cela simplement. Une architecture n’a de valeur que si elle améliore trois dimensions :

- la constance des réponses,

- la qualité sur les tâches complexes,

- le coût global d’exploitation.

Le point à retenir n’est donc pas de mémoriser les sigles, mais de comprendre le cadre de décision : si Deepseek V4 tient ses promesses architecturales, il peut devenir un excellent compromis entre sophistication technique et viabilité économique.

Autre détail loin d’être anecdotique : le modèle a été optimisé pour les puces Huawei Ascend et d’autres alternatives à Nvidia. En 2026, ce genre d’information compte. La dépendance aux GPU Nvidia reste un sujet de coût, de disponibilité et de risque industriel. Tout acteur qui ouvre une voie crédible sur d’autres environnements matériels attire forcément l’attention.

Étape 3 : examiner le pricing, car c’est là que la menace devient crédible

C’est probablement ici que Deepseek V4 commence réellement à devenir dérangeant pour les leaders du marché.

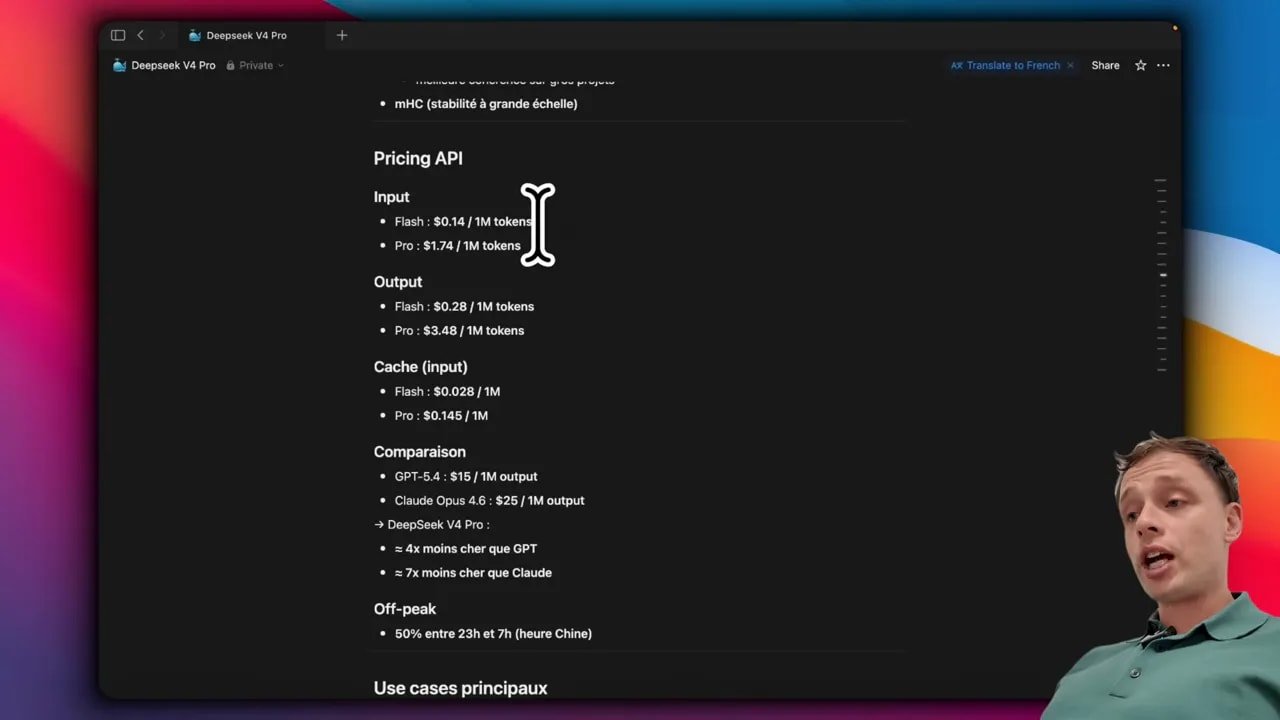

Les ordres de grandeur annoncés sont les suivants :

- Deepseek V4 Flash : 0,14 $ par million de tokens en input, 0,28 $ en output

- Deepseek V4 Pro : 1,74 $ par million de tokens en input, 3,48 $ en output

- GPT 5.4 : environ 15 $ par million de tokens en output

- Claude Opus 4.6 : environ 25 $ par million de tokens en output

À ce niveau, la comparaison devient très concrète. Sur l’output, Deepseek V4 Pro est présenté comme quatre fois moins cher que GPT 5.4 et sept fois moins cher que Claude Opus 4.6.

Pour une équipe qui exécute quelques tests par semaine, ce n’est pas décisif. Pour une structure qui :

- génère des volumes importants,

- orchestre des agents,

- industrialise du support, de l’analyse ou du code,

- ou crée des workflows intensifs en génération,

cela peut déplacer significativement le point d’équilibre économique.

La bonne question n’est donc pas “est-il moins cher ?”, car oui, il l’est nettement.

La bonne question est : “sur quelles tâches ce différentiel de prix reste-t-il compatible avec le niveau de qualité attendu ?”

Cadre de décision simple

Pour choisir rationnellement, nous pouvons utiliser cette grille :

- Si le coût par token est votre contrainte principale, testez Flash

- Si la tâche combine logique, coordination et structure, testez Pro

- Si une erreur de sortie coûte cher, ne vous fiez pas au benchmark seul, vérifiez par cas d’usage

- Si vous avez besoin d’un modèle premium sur quelques tâches critiques, gardez un fallback haut de gamme

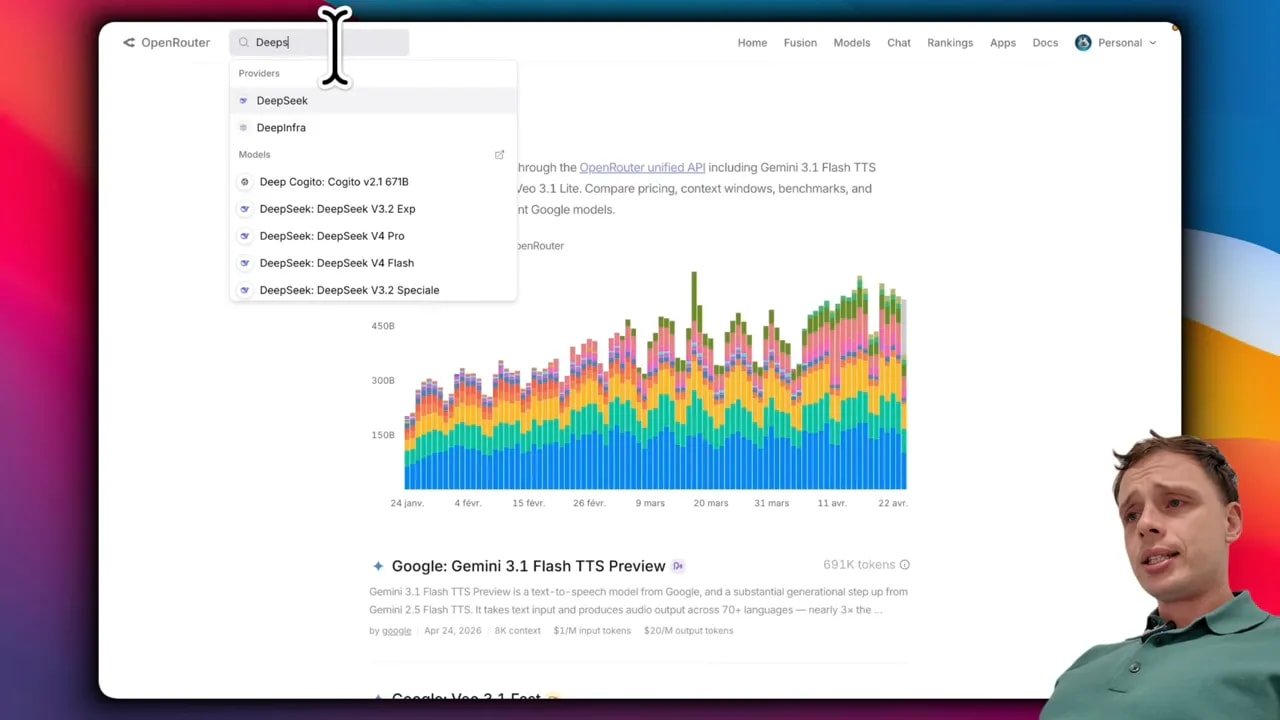

Étape 4 : tester Deepseek V4 correctement, sans se tromper de canal

Un point pratique mais essentiel : si vous voulez vraiment tester Deepseek V4 Pro, il vaut mieux éviter de tirer des conclusions depuis certaines interfaces web généralistes où le modèle utilisé n’est pas toujours parfaitement explicite.

Le canal recommandé ici est OpenRouter, en allant sélectionner directement le modèle DeepSeek V4 Pro. Cela permet de mieux contrôler l’environnement de test.

Quelques conseils utiles ressortent immédiatement :

- ajouter des crédits sur OpenRouter pour éviter les blocages,

- prévoir un petit budget de test, autour de 10 dollars suffisent largement pour commencer,

- faire attention aux limites de génération,

- si vous êtes pressé, connecter votre propre clé API DeepSeek dans OpenRouter.

C’est un détail opérationnel, mais il compte. Beaucoup de comparaisons de modèles sont biaisées par un mauvais setup de test. Si le canal bride la fréquence, altère le modèle ou introduit une couche intermédiaire, le résultat devient beaucoup moins exploitable.

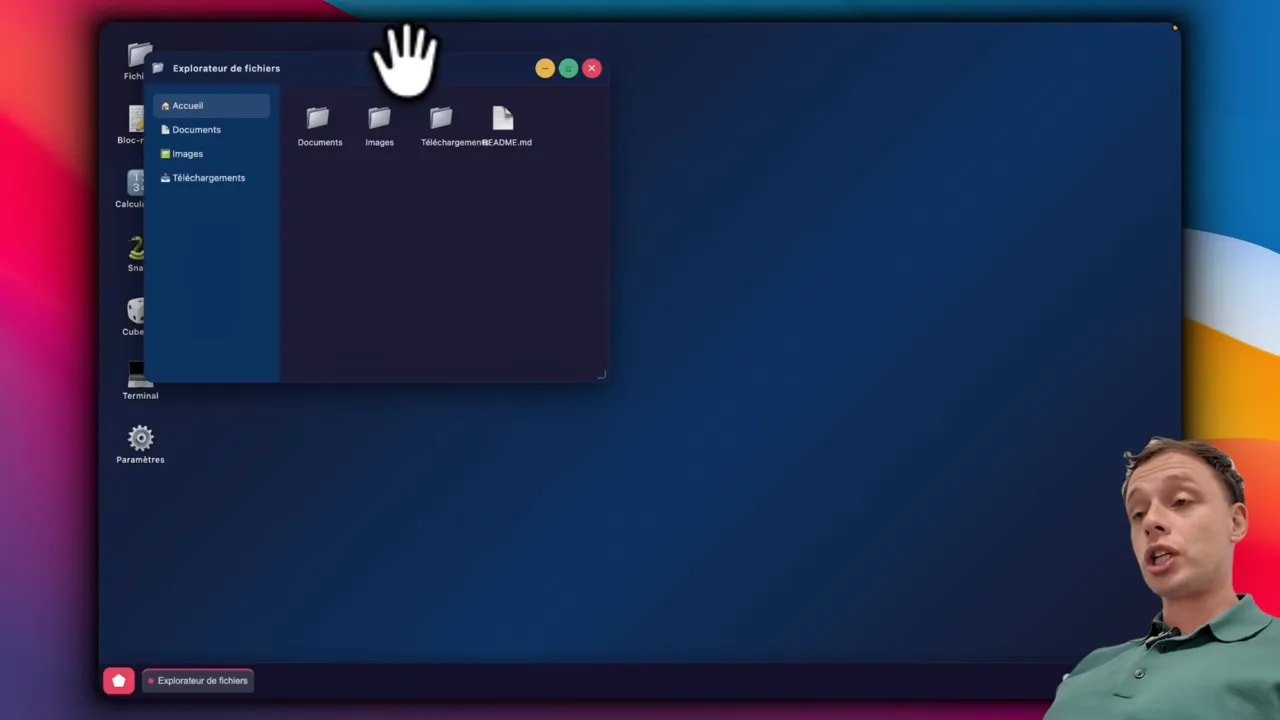

Étape 5 : commencer par un test d’interface web complexe

Premier cas concret : demander à Deepseek V4 Pro de générer une interface web complète simulant un système d’exploitation de bureau.

Ce type de prompt est excellent pour évaluer plusieurs compétences à la fois :

- la structuration HTML,

- la cohérence de l’UI,

- les interactions,

- la fluidité visuelle,

- et le respect d’un univers fonctionnel un peu large.

À première vue, le résultat est propre. Très propre, même. Fenêtres déplaçables, redimensionnement, notifications latérales, clic droit bien intégré, recherche de type Spotlight, applications classiques sur le bureau. L’ensemble paraît crédible et fluide.

Plusieurs points sont réellement positifs :

- les animations sont fluides,

- le clic droit est bien géré,

- la recherche fonctionne,

- la personnalisation de thème est présente, avec mode clair, sombre et rétro.

En revanche, dès que nous allons au-delà de la première impression, les fissures apparaissent :

- certaines icônes du bureau ne lancent pas les applications directement,

- le système de sauvegarde dans le bloc-notes ne se comporte pas comme attendu,

- les fonds d’écran censés être différents sont en réalité identiques,

- les mini-jeux intégrés sont assez inégaux.

Le jeu Snake, par exemple, fonctionne, mais avec un effet visuel assez étrange et franchement peu élégant. Le “cube 3D puzzle” est tellement confus qu’il devient presque incompréhensible. Le terminal, lui, reste sobre mais opérationnel.

Le diagnostic est donc très simple : Deepseek V4 sait produire une base d’interface web cohérente, propre et interactive. En revanche, la profondeur fonctionnelle et la finition ne suivent pas toujours jusqu’au bout.

Pour un prototype ou une démo, c’est déjà intéressant. Pour une livraison client directe, il faut encore passer derrière.

Étape 6 : mesurer la qualité visuelle avec une simulation de croissance de plante en 3D

Deuxième test, très utile pour juger la qualité graphique et la cohérence d’animation : une simulation 3D montrant l’évolution d’une graine vers une plante.

C’est un prompt exigeant, car les résultats sont souvent très aléatoires sur ce type de scène. Il faut gérer :

- la progression temporelle,

- la forme organique,

- la lisibilité visuelle,

- et un minimum de détail crédible.

Ici, Deepseek V4 livre une bonne surprise. Le rendu est jugé beau, les feuilles apparaissent de manière convaincante, les particules autour de la plante ajoutent de la vie, et le niveau de détail est supérieur à ce qui sort habituellement sur ce genre de prompt.

En zoomant, les textures et les mouvements des feuilles restent intéressants. Tout n’est pas parfait, mais le résultat franchit clairement le seuil du “simple essai technique”. Nous sommes sur quelque chose de visuellement réussi.

En termes de décision, cela veut dire que Deepseek V4 semble plus à l’aise sur certaines scènes génératives organiques que sur les interfaces complexes avec logique applicative distribuée.

Étape 7 : pousser le modèle avec un mini-jeu 3D plus complexe

Le test “Forest Robot” est un excellent révélateur de robustesse. Le concept est simple à comprendre mais difficile à bien exécuter : un petit robot low poly dans une forêt, des pièces à ramasser, des ours qui poursuivent le personnage, et une mécanique où il faut pouvoir semer ces ours pour continuer à jouer.

Pourquoi ce test est-il pertinent ? Parce qu’il combine :

- génération 3D,

- game design minimal,

- équilibrage de difficulté,

- gestion des comportements,

- et lisibilité globale.

Malheureusement, ici, Deepseek V4 Pro montre ses limites. Le principal problème vient de la vitesse des ours, trop élevée. Une fois repéré, le robot ne peut pratiquement plus s’échapper. Le cœur du gameplay est donc cassé.

À cela s’ajoutent d’autres faiblesses :

- une forêt peu attrayante,

- des mouvements peu agréables,

- des ours qui glissent sur le sol,

- une sensation générale de manque de finition.

Le contraste avec une génération obtenue auparavant avec un autre modèle est jugé net, notamment sur :

- la qualité graphique,

- la gestion de la difficulté,

- et la cohérence du jeu.

La leçon est importante : Deepseek V4 n’est pas automatiquement supérieur sur les usages interactifs complexes. Dès qu’un prompt exige à la fois de la 3D, de l’animation, des comportements, du balancing et des règles implicites bien respectées, la qualité peut chuter rapidement.

Étape 8 : vérifier la simulation physique avec un jeu de tir à l’arc 3D

Le tir à l’arc 3D est un test très intelligent, car il force le modèle à gérer des paramètres concrets comme la puissance et la gravité. Ce n’est plus simplement de la mise en page. C’est de la simulation.

Premier constat : visuellement, le rendu est plutôt moyen. Les couleurs de la verdure sont peu flatteuses et l’ensemble manque d’élégance. En revanche, la trajectoire de la flèche est une bonne surprise. La physique de tir paraît relativement crédible.

Après une demande très simple d’amélioration, sans consignes détaillées, Deepseek V4 livre une seconde version visuellement un peu meilleure. Il ajoute des nuages, rend les couleurs plus vivantes, même si certains choix restent discutables, comme le sol quadrillé.

Le point intéressant ici est double :

- la simulation de tir reste bonne,

- la logique de score et de progression devient plus claire.

Le viseur, en revanche, ne semble pas réellement utile. Cela montre encore une fois un comportement typique de nombreux modèles génératifs : ils savent produire des éléments “qui ont l’air justes”, mais pas toujours des éléments “qui servent réellement”.

Malgré cela, le jeu est considéré comme validé. Pas spectaculaire, mais fonctionnel. Et dans un cadre produit, le fonctionnel vaut souvent davantage qu’un effet “waouh” mal maîtrisé.

Étape 9 : tester un cas souvent sous-estimé, la génération de SVG

La génération de SVG est beaucoup plus importante qu’elle n’en a l’air. Dans des contextes de design, d’interface, d’illustration légère, de génération vectorielle ou d’automatisation créative, un modèle qui sait produire un SVG propre peut faire gagner un temps significatif.

Le test choisi ici est un papillon, considéré comme un cas difficile. Pourquoi ? Parce qu’il faut gérer la symétrie, les proportions, la cohérence des ailes, le placement et le respect des dimensions.

Et là, très franchement, Deepseek V4 s’en sort bien. Le papillon est symétrique, coloré, bien formé, avec des dimensions respectées.

C’est un excellent signal. Cela signifie que le modèle peut être pertinent pour :

- des besoins de design vectoriel basique à intermédiaire,

- des automatisations de supports graphiques,

- des composants visuels générés à la demande.

Ce point peut sembler secondaire, mais il compte beaucoup dans une logique de productivité opérationnelle.

Étape 10 : explorer le potentiel ludique avec un simulateur spatial 3D

Le prompt suivant demande un simulateur de vaisseau spatial low poly en orbite autour de la Terre, avec des anneaux à traverser. Le principe rappelle certains souvenirs de jeux anciens, mais ici le vrai intérêt est ailleurs : tester les mouvements dans l’espace, la caméra, la gestion des touches et la cohérence visuelle générale.

Dès le départ, l’environnement surprend agréablement. La Terre est très bien rendue, et l’ensemble visuel a une vraie personnalité.

Le problème arrive très vite : la prise en main est difficile, les touches paraissent dispersées, et piloter correctement le vaisseau devient laborieux. Malgré cela, le jeu impressionne par la quantité de mouvements pris en compte et par son ambition générale.

Le jugement ici mérite d’être nuancé avec rigueur. Si nous évaluons le jeu uniquement sur l’expérience utilisateur finale, la maniabilité pénalise fortement l’ensemble. Mais si nous évaluons la capacité du modèle à construire une base de simulateur orbital crédible, il y a quelque chose de très prometteur.

C’est pourquoi ce test peut être considéré comme validé, avec réserve. En langage produit, nous dirions : bon potentiel, UX encore faible, itération nécessaire.

Étape 11 : terminer par une scène 3D ouverte, le village chinois

Dernier test, très intéressant pour juger la génération de scène : un village chinois avec végétation, maisons, PNJ et ambiance générale.

Le premier point marquant est la végétation, réussie et assez fournie. Petits chemins, herbe, arbustes, sakuras, bambous, lac : la scène a de la densité et une certaine richesse visuelle.

En revanche, plusieurs défauts viennent dégrader le résultat :

- des particules étranges tombent du ciel et perturbent l’ambiance,

- les maisons ont des textures ou motifs assez incohérents,

- le style architectural traditionnel chinois n’est pas suffisamment convaincant,

- les PNJ traversent les bâtiments.

Quelques bons points restent présents, notamment les lanternes et certains patterns de déplacement des personnages non joueurs, plus crédibles que ce que l’on voit souvent sur ce genre de génération.

Le bilan est donc mitigé. Deepseek V4 semble capable de bien remplir une scène naturelle, mais a plus de mal à maintenir la cohérence architecturale et comportementale dès que plusieurs couches de simulation se superposent.

Étape 12 : tirer un verdict business sur Deepseek V4

Après l’ensemble de ces tests, la conclusion la plus sérieuse n’est ni “c’est une révolution absolue” ni “c’est surfait”. La réalité est plus intéressante.

Deepseek V4 est un modèle qui peut devenir redoutable pour des usages où le rapport performance-prix est central. Il montre ses points forts :

- de très bons résultats sur certains rendus visuels,

- une bonne capacité à structurer des interfaces,

- des performances solides sur des tâches techniques ciblées comme le SVG,

- et un coût qui change réellement la donne.

Mais il montre aussi des faiblesses :

- des incohérences dans la profondeur fonctionnelle,

- des problèmes de maniabilité ou de logique sur certains jeux,

- des limites dès que le prompt exige un grand nombre de paramètres coordonnés.

Autrement dit, Deepseek V4 n’est pas un remplacement automatique des meilleurs modèles premium dans tous les cas. En revanche, c’est très clairement un concurrent sérieux dès que vous raisonnez en coût total d’usage, en expérimentation rapide ou en industrialisation à marge contrainte.

5 cas où Deepseek V4 est une bonne option

- pour tester rapidement des prototypes web,

- pour générer des bases de projets interactifs,

- pour certains workflows créatifs ou visuels,

- pour réduire fortement les coûts de génération,

- pour explorer des usages agents sans exploser le budget.

Quand il faut rester prudent

- si l’expérience finale doit être impeccable sans retouche,

- si la logique métier est très dense et doit être respectée sans faille,

- si les interactions complexes doivent être parfaitement calibrées,

- si le coût d’une erreur fonctionnelle dépasse largement l’économie réalisée.

Étape 13 : mettre en place un plan d’action simple avant d’adopter Deepseek V4

Si vous souhaitez évaluer Deepseek V4 dans une logique sérieuse, voici une méthode pragmatique en trois temps.

Créer une batterie de tests maison

Ne vous contentez pas des benchmarks publics. Construisez 5 à 10 prompts correspondant à vos vrais usages :

- rédaction structurée,

- code,

- analyse,

- agents,

- automatisation,

- sorties visuelles si c’est pertinent.

Comparer à coût égal et non à réputation égale

Le bon comparatif n’est pas seulement “quel modèle est le meilleur ?”. Le bon comparatif est : quelle qualité obtenons-nous par euro dépensé ?

C’est ici que Deepseek V4 peut devenir très compétitif.

Prévoir un fallback premium

Dans une stack IA mature, il est souvent judicieux d’utiliser :

- un modèle très économique pour 70 % à 90 % des usages,

- un modèle premium pour les cas complexes ou critiques.

Cette architecture hybride est généralement meilleure pour la marge que le “tout premium”.

FAQ

Deepseek V4 est-il vraiment proche d’Opus 4.6 ?

Sur certains benchmarks annoncés, notamment SWE Bench Verified, Deepseek V4 est très proche d’Opus 4.6. En pratique, cela ne signifie pas qu’il le remplace sur tous les usages. Les tests montrent un excellent potentiel, mais aussi des limites sur les scénarios interactifs complexes.

Quelle version de Deepseek V4 choisir entre Flash et Pro ?

Choisissez Flash si votre priorité est le coût et la vitesse. Choisissez Pro si vous travaillez sur des agents, des tâches plus complexes ou des sorties nécessitant davantage de sophistication. L’arbitrage doit se faire usage par usage.

Deepseek V4 est-il intéressant pour réduire les coûts IA ?

Oui, clairement. C’est même l’un de ses principaux arguments. Les ordres de grandeur partagés montrent un coût très inférieur à certains modèles premium concurrents. Si la qualité est suffisante pour vos cas d’usage, le gain de ROI peut être significatif.

Peut-on utiliser Deepseek V4 pour générer des interfaces web ?

Oui. Deepseek V4 s’en sort bien sur la génération d’interfaces web structurées et interactives. En revanche, il faut vérifier la profondeur fonctionnelle, car certains comportements peuvent paraître finis visuellement sans être complètement robustes en usage réel.

Deepseek V4 est-il bon en génération visuelle ou 3D ?

Les résultats sont contrastés. Certaines scènes, comme la croissance d’une plante en 3D ou le simulateur spatial, sont très convaincantes. D’autres, comme certains jeux ou environnements plus complexes, révèlent des limites de gameplay, de contrôle ou de cohérence.

Quel est le meilleur moyen de tester Deepseek V4 proprement ?

Le plus prudent est de passer par un environnement où vous pouvez sélectionner explicitement le modèle, comme OpenRouter, puis de comparer les sorties sur vos propres prompts métier. C’est la seule manière d’obtenir une évaluation réellement exploitable.

Deux erreurs majeures à éviter

- Confondre benchmark et réalité opérationnelle. Un excellent score public ne garantit pas une exécution fiable sur vos cas concrets.

- Choisir uniquement sur le prix. Un modèle très économique peut coûter plus cher au final si les sorties doivent être largement reprises à la main.

Trois étapes pour démarrer ou corriger un projet avec Deepseek V4

- Définissez 5 cas d’usage prioritaires avec critères de qualité, temps gagné et risque d’erreur.

- Testez Deepseek V4 face à un modèle premium sur ces cas précis, avec le même protocole.

- Déployez une architecture hybride : Deepseek V4 pour le volume, modèle premium pour l’exception et le critique.

En résumé, Deepseek V4 n’est pas simplement une curiosité IA chinoise de plus. C’est une option sérieuse pour celles et ceux qui cherchent à concilier innovation, contrôle des coûts, et capacité d’expérimentation rapide. Il ne supprime pas la nécessité de tester, d’arbitrer et de gouverner les usages. En revanche, il ouvre une possibilité très concrète : obtenir une qualité souvent élevée à un coût qui rebat les cartes.

Et c’est précisément ce qui en fait une vraie menace concurrentielle.

Pour aller plus loin : tester, mesurer et industrialiser

Si vous utilisez Deepseek V4 pour réduire les coûts et passer à l’échelle, le plus important est de cadrer votre expérimentation : objectifs, critères de qualité, protocole de test et mesure des résultats. Pour structurer cela proprement, vous pouvez vous appuyer sur notre page dédiée à la mesure et aux KPI associés.

Ensuite, dès que vous générez davantage de contenu (notamment via des sorties visuelles comme le SVG), il devient utile d’optimiser le maillage et la distribution des pages pour maximiser la valeur produite par vos workflows.

Enfin, pour sécuriser votre démarche (éviter de prendre de mauvaises décisions sur des signaux incomplets), vous pouvez relier vos tests IA à une logique plus globale de performance digitale via ce guide sur la performance.